Počítejte prsty, sledujte okna a odrazy. Umělá inteligence má ve fotkách zatím ještě slabiny

FOTOGALERIE. Internet zahltily fotografie událostí, které se nikdy nestaly a jejichž autorem je umělá inteligence. Příkladem jsou sugestivní snímky údajného zatčení amerického exprezidenta Trumpa několik dní před tím, než byl zatčen doopravdy. Odhalit umělý původ snímků je stále možné; navzdory obrovským pokrokům není umělá inteligence není ve tvorbě fotek „na objednávku“ ještě dokonalá. Zatím. Svých slabých míst se zřejmě velmi brzy zbaví.

Je libo idylickou krajinu, nebo naopak záběry přírodní katastrofy zblízka, či emotivní portrét starého muže?

Následující realisticky vypadající galerii připravila redakce HlídacíPes.org s pomocí generátoru Midjourney verze 5.

Níže najdete i konkrétní tipy, jak poznat uměle vygenerované snímky od těch skutečných.

Foto: vygenerováno pomocí umělé inteligence Midjourney

Emoce stranou

Papež František v luxusním kabátě a zatčení bývalého amerického prezidenta Donalda Trumpa. To jsou snímky, na kterých dnes média ukazují aktuální sílu umělé inteligence Midjourney. Přestože měly na sociálních sítích tisíce sdílení, jejich umělý původ je snadno odhalitelný, ačkoli na první pohled vypadají věrohodně.

Obě zmíněné události, ke kterým nikdy nedošlo, vyvolávají emoce: jak drsné zatčení amerického exprezidenta, tak luxusní oblečení hlavy katolické církve můžou vzbuzovat pocity silného souhlasu či nesouhlasu, údivu i pohoršení.

A právě podle míry emocí, které v nás snímek vyvolává, je také dobré zvýšit ostražitost vůči pravosti fotky. Podobné pravidlo ostatně platí i pro příspěvky na sociálních sítích.

- Foto vygenerováno pomocí umělé inteligence Midjourney

- Foto vygenerováno pomocí umělé inteligence Midjourney

2. Kontext a zdroj obrázku

Oba snímky se týkají veřejně známých osobností, které jsou téměř nepřetržitě v hledáčku novinářů. Kdyby se některá z popsaných událostí skutečně stala, informovala by o tom klasická média – byť v případě papežovy luxusní bundy nejspíš hlavně ta bulvární.

Zda média o události informovala, lze zjistit i pomocí vyhledávače obrázků. Ten ukáže, v jakých médiích a v jakém kontextu se daný snímek šíří internetem. Pokud je výsledků málo nebo nevypadají přesvědčivě a obrázek nefiguruje v žádném seriózním mediálním textu, je zřejmé, že něco nehraje.

To je i důvod, proč zatím nejsou příliš účinná ani takzvaná deep fake videa, jako například to s ukrajinským prezidentem Volodymyrem Zelenskym, na němž vyzývá své vojáky ke složení zbraní.

Zelenskyj je od vypuknutí ruské invaze na Ukrajinu naopak symbolem ukrajinského odporu vůči okupantům a výzva kapitulovat by nepochybně neunikla pozornosti novinářů. Jenže v tomto případě „média mlčí“. A zcela správně – nic takového totiž ukrajinský prezident neřekl.

Wondered when Deep Fakes would start happening. Russian hackers targeted several Ukrainian sites and posted a deepfake video of Zelensky calling for troops to lay down their arms. This video is – obviously – utterly fake, but shows new dimensions of conflicts in the digital space pic.twitter.com/TM7Z4pitkG

— D.Emery (@DemeryUK) March 16, 2022

3. I umělá inteligence má slabiny. Zatím

Mnohem složitější je odhalit nepravost snímků, které se netýkají veřejných událostí a známých osobností. S rostoucí kvalitou vygenerovaných fotek lze například očekávat vznik realisticky vypadajících falešných profilů na sociálních sítích. Ty mohou účinně šířit dezinformace, propagandu nebo pochybnou reklamu pod falešnou identitou.

V takovém případě mohou „fejk“ pomoci odhalit drobné nedokonalosti na snímcích. Umělá inteligence se totiž zatím při generování realistických fotografií na základě zadání autora často dopouští chyb v detailech fotografie.

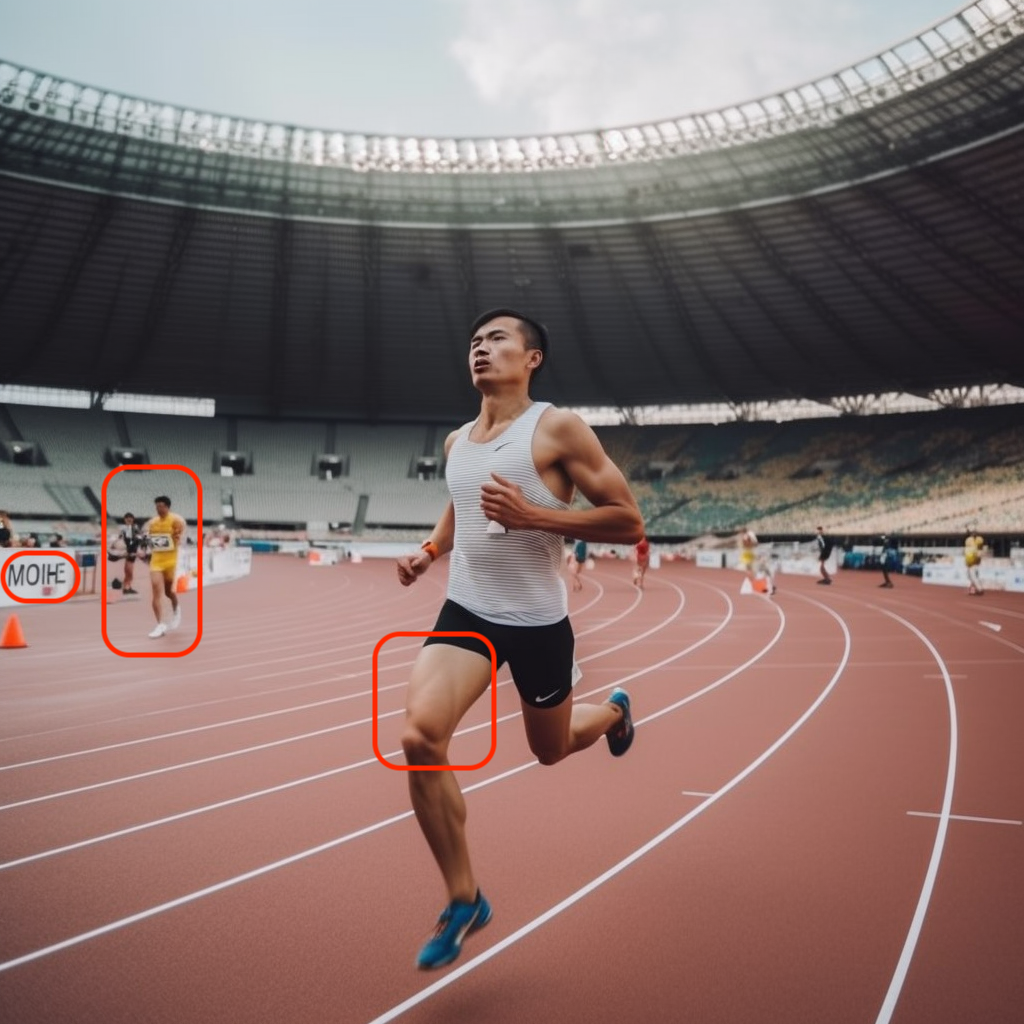

Může jít o nedokončené předměty nebo zdeformované části těla, jako jsou rozmazané oční čočky, pokřivené ruce či nohy, neodpovídající podoba svalů a podobně. Pravděpodobnost takových chyb roste s komplexností obrázku a mohou se skrývat v pozadí fotografií.

Když je na fotografii více osob, je pravděpodobné, že aspoň jedna z nich bude mít na jedné ruce více než pět prstů, případně, že prsty budou v nepřirozené pozici přeložené přes sebe. Roste i pravděpodobnost, že některý ze zobrazených obličejů bude rozmazaný, jako by na obraz spadla kapka vody. Náročné je také zatím pomocí umělé inteligence vytvořit smysluplné nápisy.

Lidské prsty jsou typickou částí fotografie, v níž umělá inteligence dosud dělala chyby. S novou verzí generátoru Midjourney však prsty začínají vypadat realisticky. Rozdíl ve zpracování zadání „muž a ruce“ lze vidět zde:

- Muž a ruce, Midjourney V4

- Muž a ruce, Midjourney V5

Dalším slabým místem jsou také snímky zobrazující člověka s mobilním telefonem, který právě sám pořizuje fotku. Obraz v jeho telefonu, který by měl odpovídat reálné situaci před ním, je totiž na umělých snímcích totiž často rozmazaný, nesprávný nebo úplně chybí.

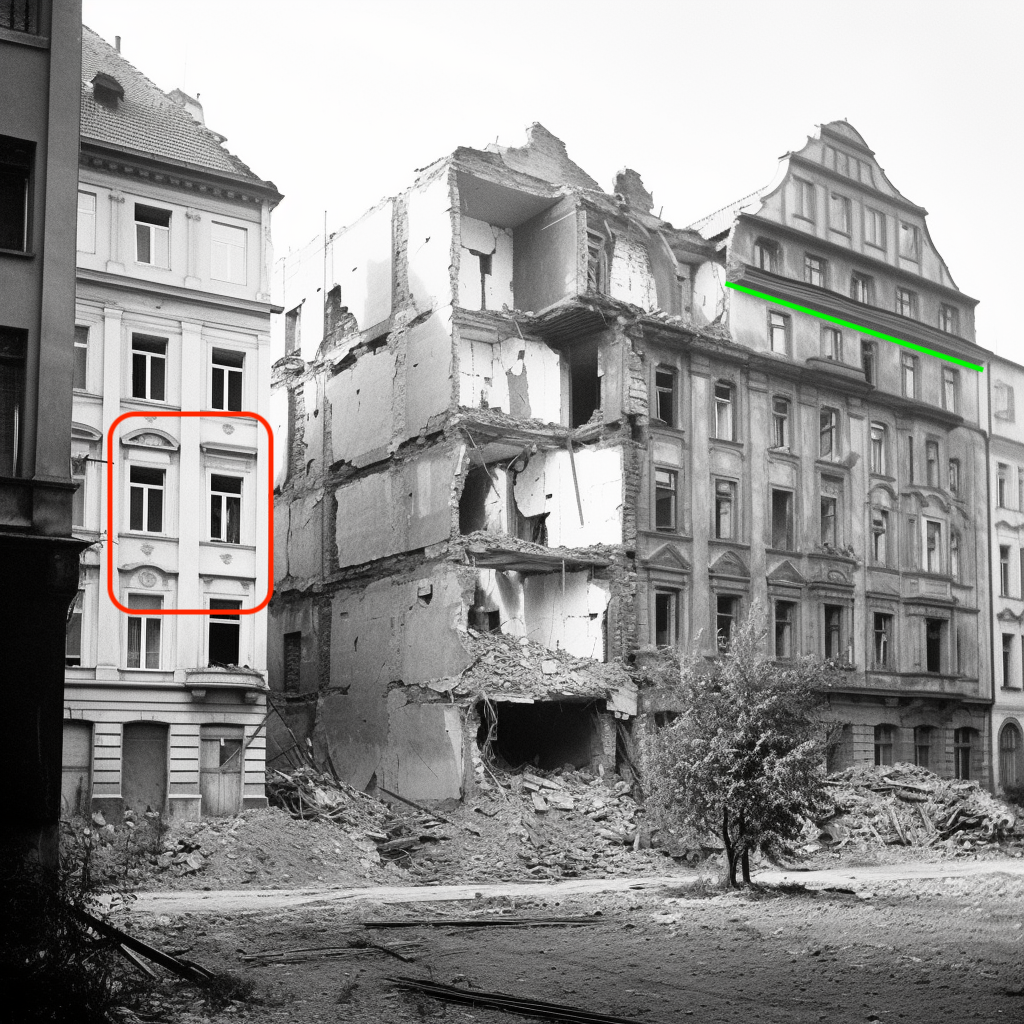

Obdobně umělá inteligence zatím pracuje i s odrazy v oknech či zrcadlech. Ty mohou buď úplně chybět nebo neodpovídají správnému úhlu pohledu.

- Foto vygenerováno pomocí MidJourney V5, autor: HlídacíPes.org

- Foto vygenerováno pomocí MidJourney V5, autor: HlídacíPes.org

- Foto vygenerováno pomocí MidJourney V5, autor: HlídacíPes.org

- Foto vygenerováno pomocí MidJourney V5, autor: HlídacíPes.org

- Foto vygenerováno pomocí MidJourney V5, autor: HlídacíPes.org

Jindy autorství umělé inteligence prozradí třeba nestejná okna nebo nepřesná práce s perspektivou. Vzdálenější objekty mohou mít jiné proporce, než by ve skutečnosti mít měly.

- Foto vygenerováno pomocí MidJourney V5, autor: HlídacíPes.org

- Foto vygenerováno pomocí MidJourney V5, autor: HlídacíPes.org

I tak je zjevné, že umělá inteligence se rychle zdokonaluje, nejen při generování realisticky působících fotografií. U nich zatím při bližším zkoumání lze díky zmíněným slabinám jejich umělý původ odhalit. Do budoucna to však bude čím dál náročnější – ne-li nemožné.

České průšvihy 1945–1948

Publikaci, jež se věnuje období takzvané třetí republiky, můžete získat pouze jako odměnu za dar v minimální výši 699 korun na činnost redakce HlídacíPes.org.

Podpořte nezávislou žurnalistiku!

Pop-up mobil Reload (397650)SMR mobil článek Mobile (207411)SMR mobil článek 2 Mobile (207416)SMR mobil článek 2 Mobile (207416-2)SMR mobil článek 2 Mobile (207416-3)SMR mobil pouze text Mobile (207431)Recommended (5901)Více z HlídacíPes.org

Čtěte též

„Nejkrvavější volby.“ Novináři v Srbsku byli brutálně napadeni při své práci

Podněcování nenávisti? Citovala jsem z Bible. Podle soudu je finská politička vinna

Skyscraper 2 Desktop (211796-4)

3 komentáře

Že je nutné to připomenout, ony se v posledních dnech množí i informace o tom, že ta umělá inteligence má problémy i v jiných oblastech, včetně i úplných základů matematiky. Jako třeba zde

https://www.zive.cz/clanky/ai-lze-ohnout-pro-piratstvi-chatgpt-generuje-klice-pro-windows-95/sc-3-a-221598/default.aspx

Čímž se tedy dostáváme k obsahu tohoto článku. Ano, při podrobném zkoumání lze zjistit že ta konkrétní uměle vytvořená fake videa či fotky jsou podvrh, lze jistě podrobným přepočtem matematických vztahů zjisti že to tvrzení umělé inteligence je nesprávné (lnepravdivé, lživé, atd..).

Ovšem to snad musí právě novináři pochopit, do jaké situace se tím dostali, když výhoda umělé inteligence je v tom, že dokáže rychle vytvářet řádově několikanásobně více informačních produktů než oni sami. Kontrolovat něco takového, kus po kuse už je zhola nemožné…A co s tím?

Pleť obličejů generovaných AI je nepřirozeně bez kosmetických vad. Asi jako Schillerové fotky upravené v nějakém bitmapovém editoru.

Dost se divím tomu, že UI dělá chyby v perspektivě, protože to je ryze matematická záležitost, kde by počítač měl být naopak „silný v kramflecích“.